Centro de Assistência Amen.pt

Instalar e utilizar o OpenClaw num VPS

O OpenClaw, anteriormente conhecido como ClawBot e MoltBot, é um agente de IA pessoal que corre na sua própria infraestrutura e que utiliza um modelo de linguagem (LLM) à sua escolha, localmente ou remotamente. O OpenClaw executa tarefas de forma autónoma e pode gerir a sua caixa de correio (incluindo o calendário), trabalhar com browsers, executar código no seu computador e muito mais.

Pode controlar o OpenClaw através de uma aplicação de chat à sua escolha, como WhatsApp, Telegram ou Signal, e também possui um dashboard. Neste guia, ira aprender a instalar o OpenClaw num servidor Linux (ou pode encomedar o seu VPS OpenClaw pronto a utilizar) e a conectá-lo a um fornecedor de LLM externo, como o GPT da OpenAI, ou a um modelo alojado localmente via Ollama.

Procura inspiração sobre o que as pessoas utilizam o OpenClaw? Veja em https://openclaw.ai/showcase.

O OpenClaw utiliza “skills” para aprender novas capacidades. Estas podem ser desenvolvidas por terceiros e estão disponíveis gratuitamente através do Clawhub. Apenas deve instalar “skills”/plugins confiáveis. Recentemente, foram detetadas skills maliciosas em registos públicos; deve rever o código-fonte antes de usar e nunca copiar-colar comandos shell suspeitos.

Instalar o OpenClaw

Passo 1

Ligue-se ao seu VPS via SSH ou através da consola do VPS.

Passo 2

Primeiro, atualize o seu servidor para que os packages de software mais recentes fiquem disponíveis:

Ubuntu:

sudo apt -y update && sudo apt -y upgrade

AlmaLinux/Rocky Linux/CentOS Stream:

sudo dnf -y update

Passo 3

O OpenClaw requer várias dependências/ajustes antes, durante e após o processo de instalação/configuração, nomeadamente:

- NodeJS 22 ou superior.

- NPM: um gestor de packages instalado por defeito com NodeJS. . No entanto, algumas configurações adicionais são necessárias para que o executável do OpenClaw possa ser utilizado. O diretório

bindo npm não é reconhecido automaticamente pelo seu sistema operacional. Pode corrigir, adicionando o diretóriobindo npm ao$PATH(uma variável de ambiente que informa o seu SO onde os arquivos executáveis estão localizados). - Brew: Para utilizar skills (ou seja, o que OpenClaw pode fazer além de chat), também precisa do Homebrew.

Copie e cole o código abaixo, dependendo do sistema operativo:

Ubuntu / Debian:

curl -fsSL https://deb.nodesource.com/setup_24.x | sudo bash sudo apt -y install nodejs echo 'export PATH="$(npm prefix -g)/bin:$PATH"' >> ~/.bashrc source ~/.bashrc /bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)" echo >> ~/.bashrc grep -qxF 'eval "$(/home/linuxbrew/.linuxbrew/bin/brew shellenv bash)"' ~/.bashrc \ || echo 'eval "$(/home/linuxbrew/.linuxbrew/bin/brew shellenv bash)"' >> ~/.bashrc eval "$(/home/linuxbrew/.linuxbrew/bin/brew shellenv bash)" sudo apt -y install build-essentialAlmaLinux / Rocky Linux / CentOS Stream:

curl -fsSL https://deb.nodesource.com/setup_24.x | sudo bash sudo dnf -y install nodejs echo 'export PATH="$(npm prefix -g)/bin:$PATH"' >> ~/.bashrc source ~/.bashrc /bin/bash -c "$(curl -fsSL https://raw.githubusercontent.com/Homebrew/install/HEAD/install.sh)" echo >> ~/.bashrc grep -qxF 'eval "$(/home/linuxbrew/.linuxbrew/bin/brew shellenv bash)"' ~/.bashrc \ || echo 'eval "$(/home/linuxbrew/.linuxbrew/bin/brew shellenv bash)"' >> ~/.bashrc eval "$(/home/linuxbrew/.linuxbrew/bin/brew shellenv bash)" sudo dnf -y update && sudo dnf -y groupinstall "Development Tools" && sudo dnf -y install gcc-c++ makePasso 5

Instale o OpenClaw através de um script de instalação (recomendado) ou Docker.

Script de instalação (recomendado)

Execute o script oficial:

curl -fsSL https://openclaw.ai/install.sh | bash

Assim, instala a CLI (Command Line Interface) do OpenClaw. Por defeito, um processo de onboarding inicia-se após a instalação. Se saltar ou interromper o onboarding, pode iniciá-lo manualmente após a instalação com o comando:

openclaw onboard --install-daemon

--install-daemon cria um serviço systemd para que o gateway continue a correr em segundo plano.

Docker (gateway em container)

- Primeiro, deve instalar o Docker e o Docker Compose (v2). Em seguida, deve iniciar e ativar o serviço Docker:

sudo apt -y update && sudo apt -y install docker.io docker-compose-plugin sudo systemctl enable --now docker

2. Deve clonar o repositório do OpenClaw e executar o script de configuração Docker:

git clone https://github.com/openclaw/openclaw.git

cd openclaw

./docker-setup.sh

Este processo cria a imagem, executa o onboarding (consulte a secção seguinte) e inicia o gateway através do Compose.

3. Deve abrir o painel e associar o navegador (se necessário). Mostrar o URL do painel sem o abrir automaticamente:

docker compose run --rm openclaw-cli dashboard --no-open

(Opcional) aprovar um pedido de associação:

docker compose run --rm openclaw-cli devices list

docker compose run --rm openclaw-cli devices approve

Deve utilizar o contentor CLI para associar dispositivos e ligar canais de comunicação.

O processo de onboarding do OpenClaw

Se o onboarding não foi iniciado ou foi interrompido, execute:

openclaw onboard --install-daemon

Durante este processo, ajuste seleções com as teclas de seta. Quando existem múltiplas opções selecionáveis, utilize a barra de espaço para escolher e, em cada passo, pressione Enter para confirmar.

Passo 1

Irá visualizar um aviso de segurança. Recomenda-se lê-lo cuidadosamente; dependendo da configuração, o OpenClaw pode ter acesso ao computador/servidor, contas sociais e e-mail, podendo causar danos sérios se não estiver configurado de forma segura (alojar o OpenClaw num VPS já reduz vários riscos).

◇ Security ──────────────────────────────────────────────────────────────────────────────╮

│ │

│ Security warning — please read. │

│ OpenClaw is a hobby project and still in beta. Expect sharp edges. │

│ This bot can read files and run actions if tools are enabled. │

│ A bad prompt can trick it into doing unsafe things. │

│ If you’re not comfortable with basic security and access control, don’t run OpenClaw. │

│ Ask someone experienced to help before enabling tools or exposing it to the internet. │

│ Recommended baseline: │

│ - Pairing/allowlists + mention gating. │

│ - Sandbox + least-privilege tools. │

│ - Keep secrets out of the agent’s reachable filesystem. │

│ - Use the strongest available model for any bot with tools or untrusted inboxes. │

│ Run regularly: │

│ openclaw security audit --deep │

│ openclaw security audit --fix │

│ Must read: https://docs.openclaw.ai/gateway/security │

╰─────────────────────────────────────────────────────────────────────────────────────────╯

O OpenClaw solicitará permissão explícita para continuar o processo de integração (onboarding). Selecione ‘Yes’ (Sim) usando as teclas de seta e pressione ‘Enter’ para conceder a permissão.

◆ I understand this is powerful and inherently risky. Continue?

│ ● Yes / ○ No

└

Passo 2

Pressione ‘Enter’ novamente para selecionar ‘Quickstart’ (Início Rápido) como o método de integração. Todas as etapas do processo de integração são opcionais, e discutiremos as mais importantes em seções separadas.

◆ Onboarding mode │ ● QuickStart (Configure details later via openclaw configure.) │ ○ Manual └

Passo 3

Agora terá a opção de selecionar um provedor de LLM, com duas escolhas:

- Se pretender utilizar um modelo self-hosted via Ollama, seleciona ‘Skip for now’.

- Se preferir utilizar um fornecedor de LLM disponível, deve ter as credenciais OAuth/API prontas e selecionar o fornecedor desejado.

◆ Model/auth provider

│ ○ OpenAI

│ ○ Anthropic

│ ○ MiniMax

│ ○ Moonshot AI

│ ○ OpenRouter

│ ○ Qwen

│ ○ Z.AI (GLM 4.7)

│ ○ Copilot

│ ○ Vercel AI Gateway

│ ○ OpenCode Zen

│ ○ Xiaomi

│ ○ Synthetic

│ ○ Venice AI

│ ● Skip for now

└

OpenAI example

For example, if you select OpenAI and want to use an API key, the next options will look like this:

◇ QuickStart ─────────────────────────╮

│ │

│ Gateway port: 18789 │

│ Gateway bind: Loopback (127.0.0.1) │

│ Gateway auth: Token (default) │

│ Tailscale exposure: Off │

│ Direct to chat channels. │

│ │

├──────────────────────────────────────╯

│

◇ Model/auth provider

│ OpenAI

│

◇ OpenAI auth method

│ OpenAI API key

│

◆ Enter OpenAI API key

│ a1234-qqw123aa-asdasd1█

Passo 4

No passo 5, irá escolher um modelo de linguagem (LLM) específico. Para manter as opções sob controlo, pode selecionar um provedor de LLM agora.

- Está a utilizar o Ollama ou deseja configurar um LLM mais tarde? Então, pressione ‘Enter’ para selecionar ‘All providers’ (Padrão) em ‘Filter models by providers’ (Filtrar modelos por provedores).

- Escolheu um provedor específico no passo anterior? Então, selecione-o na lista abaixo. No próximo passo, você poderá selecionar qual modelo deseja usar.

◆ Filter models by provider │ ● All providers │ ○ amazon-bedrock │ ○ anthropic │ ○ azure-openai-responses │ ○ cerebras │ ○ github-copilot │ ○ google │ ○ google-antigravity │ ○ google-gemini-cli │ ○ google-vertex │ ○ groq │ ○ huggingface │ ○ kimi-coding │ ○ minimax │ ○ minimax-cn │ ○ mistral │ ○ openai │ ○ openai-codex │ ○ opencode │ ○ openrouter │ ○ vercel-ai-gateway │ ○ xai │ ○ zai └

Passo 5

Está a usar o Ollama ou deseja configurar um LLM mais tarde? Então pressione ‘Enter’ para selecionar ‘Keep current’ (Padrão) em ‘Default model’ (Modelo padrão).

Escolheu um provedor específico no passo anterior? Então, selecione o modelo desejado na lista que aparecerá; nesse caso, a lista será mais curta e mostrará apenas os modelos do provedor que selecionou no menu anterior.

◆ Default model │ ● Keep current (default: anthropic/claude-opus-4-5) │ ○ Enter model manually │ ○ amazon-bedrock/anthropic.claude-3-haiku-20240307-v1:0 │ ○ amazon-bedrock/anthropic.claude-3-5-haiku-20241022-v1:0 │ ○ amazon-bedrock/global.anthropic.claude-haiku-4-5-20251001-v1:0 │ ○ amazon-bedrock/eu.anthropic.claude-haiku-4-5-20251001-v1:0 │ ○ amazon-bedrock/anthropic.claude-3-opus-20240229-v1:0 │ ○ amazon-bedrock/us.anthropic.claude-opus-4-20250514-v1:0 │ ○ amazon-bedrock/us.anthropic.claude-opus-4-1-20250805-v1:0 │ ○ amazon-bedrock/global.anthropic.claude-opus-4-5-20251101-v1:0 │ ○ amazon-bedrock/eu.anthropic.claude-opus-4-5-20251101-v1:0 │ ○ amazon-bedrock/anthropic.claude-3-sonnet-20240229-v1:0 │ ○ amazon-bedrock/anthropic.claude-3-5-sonnet-20240620-v1:0 │ ○ amazon-bedrock/anthropic.claude-3-5-sonnet-20241022-v2:0 │ ○ amazon-bedrock/us.anthropic.claude-3-7-sonnet-20250219-v1:0 │ ○ amazon-bedrock/global.anthropic.claude-sonnet-4-20250514-v1:0 │ ○ amazon-bedrock/global.anthropic.claude-sonnet-4-5-20250929-v1:0 │ ○ amazon-bedrock/eu.anthropic.claude-sonnet-4-5-20250929-v1:0 │ ○ amazon-bedrock/cohere.command-r-v1:0 │ ○ amazon-bedrock/cohere.command-r-plus-v1:0 │ ○ amazon-bedrock/us.deepseek.r1-v1:0 │ ○ amazon-bedrock/deepseek.v3-v1:0 │ ○ amazon-bedrock/google.gemma-3-4b-it │ ○ amazon-bedrock/google.gemma-3-27b-it │ ○ amazon-bedrock/openai.gpt-oss-safeguard-120b │ ○ amazon-bedrock/openai.gpt-oss-safeguard-20b │ ○ amazon-bedrock/openai.gpt-oss-120b-1:0 │ ○ amazon-bedrock/openai.gpt-oss-20b-1:0 │ ○ amazon-bedrock/moonshot.kimi-k2-thinking │ ○ amazon-bedrock/meta.llama3-1-70b-instruct-v1:0 │ ○ amazon-bedrock/meta.llama3-1-8b-instruct-v1:0 │ ○ amazon-bedrock/us.meta.llama3-2-11b-instruct-v1:0 │ ○ amazon-bedrock/us.meta.llama3-2-1b-instruct-v1:0 │ ○ amazon-bedrock/us.meta.llama3-2-3b-instruct-v1:0 │ ○ amazon-bedrock/us.meta.llama3-2-90b-instruct-v1:0 │ ○ amazon-bedrock/us.meta.llama3-3-70b-instruct-v1:0 │ ○ amazon-bedrock/us.meta.llama4-maverick-17b-instruct-v1:0 │ ○ amazon-bedrock/us.meta.llama4-scout-17b-instruct-v1:0 │ ○ amazon-bedrock/minimax.minimax-m2 │ ○ amazon-bedrock/mistral.ministral-3-14b-instruct │ ○ amazon-bedrock/mistral.ministral-3-8b-instruct │ ○ amazon-bedrock/mistral.mistral-large-2402-v1:0 │ ○ amazon-bedrock/global.amazon.nova-2-lite-v1:0 │ ○ amazon-bedrock/us.amazon.nova-lite-v1:0 │ ○ amazon-bedrock/us.amazon.nova-micro-v1:0 │ ○ amazon-bedrock/us.amazon.nova-premier-v1:0 │ ○ amazon-bedrock/us.amazon.nova-pro-v1:0 │ ○ amazon-bedrock/nvidia.nemotron-nano-12b-v2 │ ○ amazon-bedrock/nvidia.nemotron-nano-9b-v2 │ … └

Passo 6

De seguida, poderá escolher um único canal para comunicar com o OpenClaw (e, opcionalmente, adicionar outras opções depois). Mais adiante neste artigo, mostraremos em detalhe como configurar o WhatsApp, o Telegram e o Signal. Tem liberdade total para selecionar qualquer uma das opções disponíveis; o OpenClaw guiá-lo-á pelo processo de configuração, e abaixo desta visão geral encontrará um exemplo de como isso funciona para o Telegram.

◆ Select channel (QuickStart) │ ● Telegram (Bot API) │ ○ WhatsApp (QR link) │ ○ Discord (Bot API) │ ○ Google Chat (Chat API) │ ○ Slack (Socket Mode) │ ○ Signal (signal-cli) (not configured) │ ○ iMessage (imsg) │ ○ Nostr (NIP-04 DMs) │ ○ Microsoft Teams (Bot Framework) │ ○ Mattermost (plugin) │ ○ Nextcloud Talk (self-hosted) │ ○ Matrix (plugin) │ ○ BlueBubbles (macOS app) │ ○ LINE (Messaging API) │ ○ Zalo (Bot API) │ ○ Zalo (Personal Account) │ ○ Tlon (Urbit) │ ○ Skip for now └ Exemplo com Telegram

Siga os passos abaixo. A forma mais fácil é fazer login através do seu browser at https://web.telegram.org e seguir os passos indicados.

◆ Select channel (QuickStart)

│ ● Telegram (Bot API)

│ ○ WhatsApp (QR link)

│ ○ Discord (Bot API)

│ ○ Google Chat (Chat API)

│ ○ Slack (Socket Mode)

│ ○ Signal (signal-cli) (not configured)

│ ○ iMessage (imsg)

│ ○ Nostr (NIP-04 DMs)

│ ○ Microsoft Teams (Bot Framework)

│ ○ Mattermost (plugin)

│ ○ Nextcloud Talk (self-hosted)

│ ○ Matrix (plugin)

│ ○ BlueBubbles (macOS app)

│ ○ LINE (Messaging API)

│ ○ Zalo (Bot API)

│ ○ Zalo (Personal Account)

│ ○ Tlon (Urbit)

│ ○ Skip for now

└

Passo 7

Escolha os “skills” que o OpenClaw pode usar:

- Selecione ‘Yes’ em ‘Configure skills now?’

- Selecione ‘No’ em ‘Show Homebrew install command?’

- Selecione ‘NPM’ como gestor de node preferido

- Selecione uma ou mais skills com a barra de espaço e pressiona ‘Enter’ para as instalar. Algumas destas skills requerem chaves API externas — por exemplo, a geração de imagens através de nano-banana-pro utiliza Gemini Pro 3 Image Preview e exige uma chave API do Google AI Studio.

Algumas skills úteis para instalar imediatamente, e que não requerem chaves API, são:

- Clawhub: permite adicionar facilmente, mais tarde, novas skills ao OpenClaw que não estão listadas aqui, mas que estão disponíveis no Clawhub (o website onde os utilizadores podem partilhar novas skills).

- Nano-pdf: permite ao OpenClaw modificar ficheiros PDF.

- OpenAI-whisper: instala um módulo local de Speech-to-Text. Isto permite que, posteriormente, envie mensagens de voz ao OpenClaw via WhatsApp, Telegram ou Signal, às quais o OpenClaw poderá responder. Nota: num teste, ocorreu um bug. Existe uma versão com API e outra sem API para o módulo STT, e foi utilizada a versão com API em vez da local. Se isto também acontecer, ele corrige a situação no dashboard web, na página ‘skills’.

- Summarize: uma skill que permite ao OpenClaw resumir URLs, podcasts e ficheiros de texto.

Skills status ────────────╮

│ │

│ Eligible: 4 │

│ Missing requirements: 45 │

│ Blocked by allowlist: 0 │

│ │

├────────────────────────────╯

│

◇ Configure skills now? (recommended)

│ Yes

│

◇ Homebrew recommended ──────────────────────────────────────────────────────────╮

│ │

│ Many skill dependencies are shipped via Homebrew. │

│ Without brew, you'll need to build from source or download releases manually. │

│ │

├─────────────────────────────────────────────────────────────────────────────────╯

│

◇ Show Homebrew install command?

│ No

│

◇ Preferred node manager for skill installs

│ ● npm

│ ○ pnpm

│ ○ bun

◆ Install missing skill dependencies

│ ◻ Skip for now (Continue without installing dependencies)

│ ◻ 🔐 1password

│ ◻ 📝 apple-notes

│ ◻ ⏰ apple-reminders

│ ◻ 🐻 bear-notes

│ ◻ 🐦 bird

│ ◻ 📰 blogwatcher

│ ◻ 🫐 blucli

│ ◻ 📸 camsnap

│ ◻ 🧩 clawhub

│ ◻ 🎛️ eightctl

│ ◻ ♊️ gemini

│ ◻ 🧲 gifgrep

│ ◻ 🐙 github

│ ◻ 🎮 gog

│ ◻ 📍 goplaces

│ ◻ 📧 himalaya

│ ◻ 📨 imsg

│ ◻ 📦 mcporter

│ ◻ 📊 model-usage

│ ◻ 🍌 nano-banana-pro

│ ◻ 📄 nano-pdf

│ ◻ 💎 obsidian

│ ◻ 🎙️ openai-whisper

│ ◻ 💡 openhue

│ ◻ 🧿 oracle

│ ◻ 🛵 ordercli

│ ◻ 👀 peekaboo

│ ◻ 🗣️ sag

│ ◻ 🌊 songsee

│ ◻ 🔊 sonoscli

│ ◻ 🧾 summarize

│ ◻ ✅ things-mac

│ ◻ 🎞️ video-frames

│ ◻ 📱 wacli

└Passo 8

Por fim, pode ativar os hooks. Recomenda-se selecionar as três últimas opções. Em termos simples, os hooks permitem automatizar ações que são acionadas automaticamente com base em eventos e comandos do agente. Recomenda-se a leitura desta página sobre hooks, bem como a consulta do que é possível fazer com webhooks.

◆ Enable hooks? │ ◼ 🚀 boot-md │ ◼ 📝 command-logger │ ◼ 💾 session-memory └

Passo 9

Serão agora apresentadas várias mensagens, mas a parte mais importante é o bloco abaixo.

- Primeiro, deve anotar o valor do token no URL em ‘Web UI (with token)’.

- No final, ser-lhe-á perguntado como pretende iniciar o bot. Está a utilizar um fornecedor externo de LLM como OpenAI ou Anthropic? Nesse caso, deve pressionar ‘Enter’ para selecionar a opção predefinida ‘Hatch in TUI’ (Terminal User Interface).

Está a utilizar Ollama? Então deve selecionar ‘Do this later’ e continuar para a secção seguinte. - Se escolher ‘Do this later’, ser-lhe-á perguntado se pretende instalar um script de conclusão de shell. Deve selecionar ‘Yes’ caso essa mensagem apareça.

◇ Control UI ─────────────────────────────────────────────────────────────────────╮

│ │

│ Web UI: http://127.0.0.1:18789/ │

│ Web UI (with token): │

│ http://127.0.0.1:18789/?token=e734015d3d31a19481f56875a3191c2 │

│ Gateway WS: ws://127.0.0.1:18789 │

│ Gateway: reachable │

│ Docs: https://docs.openclaw.ai/web/control-ui │

│ │

├──────────────────────────────────────────────────────────────────────────────────╯

│

◇ Start TUI (best option!) ─────────────────────────────────╮

│ │

│ This is the defining action that makes your agent you. │

│ Please take your time. │

│ The more you tell it, the better the experience will be. │

│ We will send: "Wake up, my friend!" │

│ │

├────────────────────────────────────────────────────────────╯

│

◇ Token ────────────────────────────────────────────────────────────────────────────────╮

│ │

│ Gateway token: shared auth for the Gateway + Control UI. │

│ Stored in: ~/.openclaw/openclaw.json (gateway.auth.token) or OPENCLAW_GATEWAY_TOKEN. │

│ Web UI stores a copy in this browser's localStorage (openclaw.control.settings.v1). │

│ Get the tokenized link anytime: openclaw dashboard --no-open │

│ │

├────────────────────────────────────────────────────────────────────────────────────────╯

│

◆ How do you want to hatch your bot?

│ ● Hatch in TUI (recommended)

│ ○ Open the Web UI

│ ○ Do this later

└Passo 10

O OpenClaw pretende agora saber mais sobre quem quer que o OpenClaw seja: qual será o nome do bot, que tipo de “ambiente” pretende nas interações e que função deverá desempenhar. O OpenClaw também pretende saber quem é o utilizador. Assim, será apresentada uma mensagem como:

session agent:main:main

Wake up, my friend!

Hey! Just woke up in this fresh workspace. I'm a blank slate right now—who am I supposed to be? What's my name, vibe, or role? And who are you? Let's figure this out together. 🚀Por exemplo, algumas linhas como:

“You are <name>. You are a helpful, highly skilled assistant. Your vibe in general is warm, supportive, friendly, with a sense of humour. As for who I am, my name is <name>. I'm a <job description> and live in <city, country>. I generally like <interests, hobbies, w/e>. Please let me know if you'd like to know anything else about me or yourself. Also, anything else you'd recommend that I should know or tweak about you?"

Com base na primeira resposta, receberá várias sugestões sobre o que pode ajustar, por exemplo:

1. Proactivity prefs: HEARTBEAT.md is empty, so I'm not pinging you periodically (e.g., email checks, calendar nudges). Want me to set up light heartbeats (2-3x/day) for weather, urgent emails, or "hey, gym time?" Or cron for

precise stuff like "remind me to read at 8 PM"?

2. External actions: Per my soul (SOUL.md), I ask before emailing/tweeting/posting publicly. Cool? Or greenlight certain channels?

3. Voice fun: If TTS kicks in for stories or summaries, any fave voices? (E.g., warm British for sci-fi recaps.)

4. Your world: <questions based on what you said before>É tudo! Após a conversa atual, o OpenClaw estará pronto a funcionar. Ao conversar com o OpenClaw, é possível alterar muitas definições simplesmente fazendo perguntas e respondendo às questões que o OpenClaw colocar. Pronto? Nesse caso, deve usar ctrl + c para sair da TUI.

Ligar ao painel OpenClaw (GUI) a partir do computador/laptop

Neste guia, parte-se do princípio de que o OpenClaw está a ser instalado num VPS. Por exemplo, se instalar o OpenClaw num VPS com Ubuntu sem ambiente gráfico, não poderá simplesmente abrir um navegador para gerir o painel OpenClaw.

Existe uma forma relativamente simples e segura de continuar a aceder ao painel OpenClaw: configurando um túnel SSH. Isto pode ser feito facilmente a partir do terminal/PowerShell/WSL do próprio computador ou portátil com um único comando:

ssh -N -L 18789:127.0.0.1:18789 -p 12345 username@123.123.123.123 Substituir neste comando:

- 12345 pelo número da porta utilizada para ligações SSH. Não alterou a porta? Nesse caso, deve utilizar -p 22 (ou omiti-lo).

- username pelo nome de utilizador utilizado para estabelecer ligação ao VPS.

- 23.123.123.123 pelo endereço IP ou por um nome de (sub)domínio que aponte para o VPS (por exemplo, claw.example.nl).

Abra o browser no computador/portátil onde configurou o túnel SSH e aceda a 127.0.0.1:18789. Será então encaminhado para o painel OpenClaw. Consulte a secção abaixo.

Usar o dashboard OpenClaw

Primeiro login

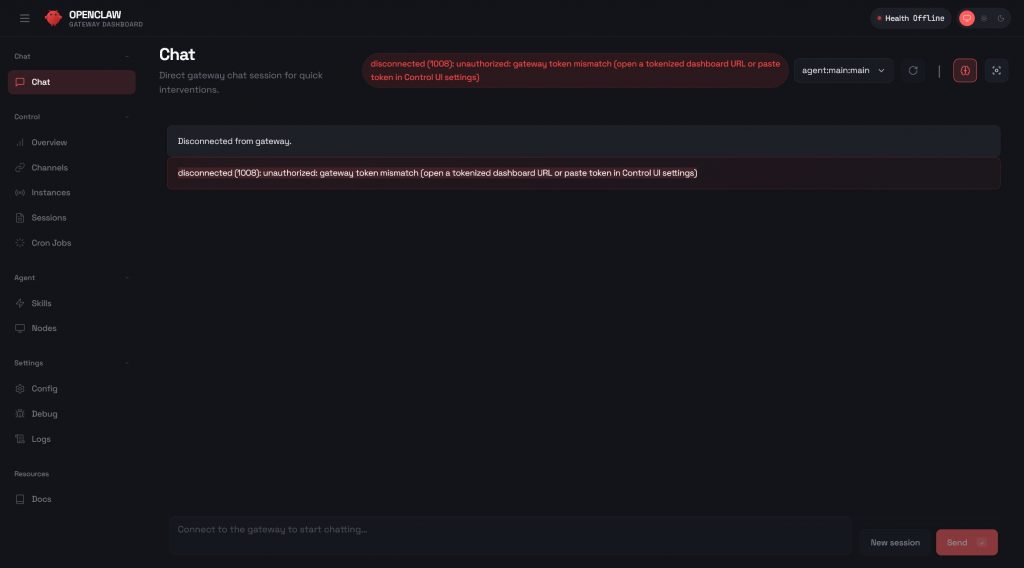

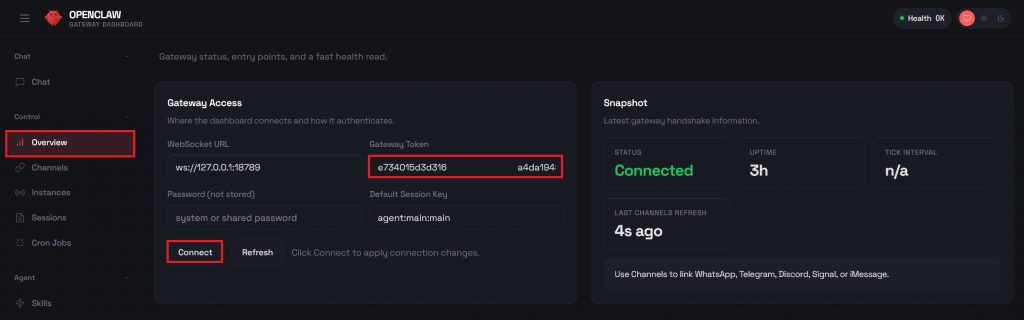

Ao abrir o painel OpenClaw através de 127.0.0.1:18789, surgirá uma mensagem de erro como na imagem abaixo. Este erro ocorre porque o token não está incluído no URL, por exemplo:

http://127.0.0.1:18789/?token=e734015d3d31a19481f56875a3191c2

Esta é uma opção intencional: é mais simples configurar o token uma vez e depois utilizar sempre o endereço 127.0.0.1:18789.

Deve clicar em ‘Overview’ e colar o token copiado em ‘Gateway token’, depois clicar em ‘Connect’. O estado mudará para ‘Connected’ e poderá utilizar o painel sem mais problemas.

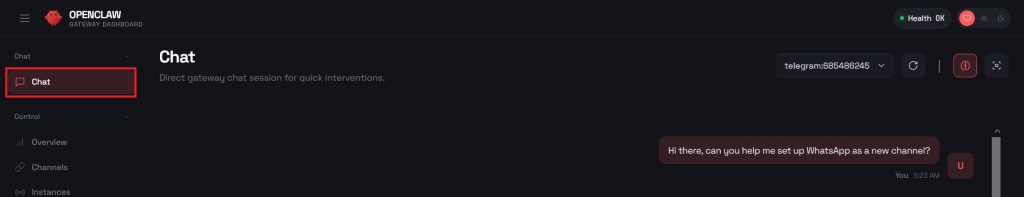

Conversar com o OpenClaw através do painel

Para iniciar uma conversa com o OpenClaw, basta clicar em ‘Chat’ no menu do lado esquerdo e poderá começar imediatamente uma sessão de chat.

Nota: por predefinição, tanto a TUI de linha de comandos como o painel web apresentam também mensagens de sistema no chat que não aparecem em conversas noutros canais, como o Telegram. Estas mensagens podem ser ignoradas com segurança, desde que o OpenClaw funcione corretamente no canal de comunicação escolhido.

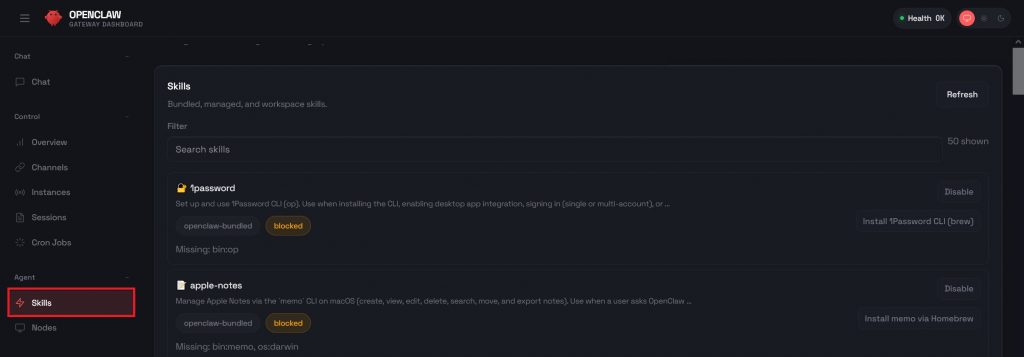

Adicionar/ativar skills existentes

O OpenClaw inclui um vasto conjunto de competências que podem ser utilizadas de imediato, bastando ativá-las. Deve clicar em ‘Skills’ no menu do lado esquerdo e ativar as competências pretendidas. Note que algumas requerem chaves de API de sistemas externos para funcionarem.

Segurança OpenClaw

O OpenClaw é um agente poderoso que pode representar um risco de segurança significativo. Por exemplo, ao ligar o OpenClaw ao email profissional, estará potencialmente a confiar num agente de IA — e no LLM a ele associado — para gerir corretamente o correio eletrónico.

Para utilizar o OpenClaw da forma mais segura possível, recomenda-se:

• Ler as dicas de segurança em https://docs.openclaw.ai/gateway/security

• Não instalar o OpenClaw num computador ou portátil que contenha dados pessoais/empresariais; em vez disso, utilizar um VPS, por exemplo.

• Executar uma auditoria de segurança à configuração do OpenClaw:

openclaw security audit --deep

Adicionar novo canal de comunicação

Pretende adicionar posteriormente outro canal de comunicação ao OpenClaw: por exemplo, o WhatsApp? Existem duas opções simples:

- Pedir ao OpenClaw para adicionar o canal de comunicação, por exemplo através da TUI, do painel web ou de um canal já existente.

- Executar novamente o onboarding com o comando:

openclaw onboard

• Através da linha de comandos; utilizando os três comandos abaixo, por exemplo, adiciona-se o gpt-5-mini da OpenAI como alias, define-se como predefinido e reinicia-se o gateway para aplicar as alterações.

openclaw models aliases add g5mini openai/gpt-5-mini

openclaw models set openai/gpt-5-mini

openclaw gateway restart

O que se segue com o OpenClaw?

Para começar: deve falar com o OpenClaw. Pretende configurar “algo”, como uma nova skill? Basta perguntar ao OpenClaw e este indicará os próximos passos.

Prefere uma GUI? É igualmente simples: deve ligar-se ao painel OpenClaw e aceder à página ‘Skills’.

Resolução de problemas e gestão

Existem vários comandos úteis para gerir o OpenClaw e para perceber quando existe um problema e não está a receber qualquer resposta através da TUI, do chat no painel web ou do canal de comunicação escolhido. Noutros casos, pode ser mais simples falar diretamente com o OpenClaw.

Atualizar o OpenClaw

openclaw update

Verificação de estado (health check)

Para uma verificação rápida, especialmente dos canais:

openclaw health

Estado do OpenClaw

Verificar o estado com muito mais detalhe do que com o comando health:

openclaw status

Estado do gateway

openclaw gateway status

Verificar modelos disponíveis

openclaw model list

Verificar estado de um modelo

openclaw model status

Ver logs

openclaw logs

OpenClaw doctor

Tentar corrigir automaticamente problemas, desde que não estejam relacionados com a configuração do LLM:

You haven't found what you are looking for?

Entre em contato com nossos profissionais, terão todo o gosto em ajudar!

Contact us